- シンクタンクならニッセイ基礎研究所 >

- 経営・ビジネス >

- 法務 >

- AI事業者ガイドライン-総務省・経済産業省のガイドライン

2024年12月03日

文字サイズ

- 小

- 中

- 大

5――AIガバナンスの構築

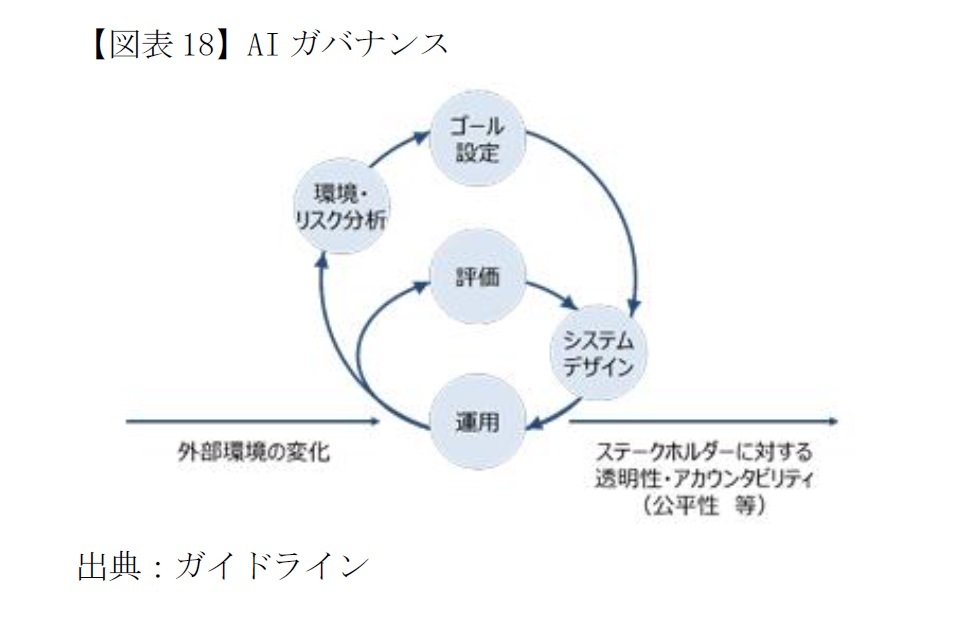

ガイドラインでは、各主体間で連携しバリューチェーン全体で『共通の指針』を実践しAIを安全安心に活用していくためには、AIに関するリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる便益を最大化するための、AIガバナンスの構築が重要となるとする14。

具体的には、

(1) AIシステム・サービスがライフサイクル全体においてもたらしうる便益/リスク、開発・運用に関する社会的受容、外部環境の変化、AI習熟度等を踏まえ、対象となるAIシステム・サービスに関連する「環境・リスク分析」を実施する。

(2) これを踏まえ、AIシステム・サービスを開発・提供・利用するか否かを判断し、開発・提供・利用する場合には、AIガバナンスに関するポリシーの策定等を通じて「AIガバナンス・ゴールの設定」を検討する。なお、このAIガバナンス・ゴールは、各主体の存在意義、理念・ビジョンといった経営上のゴールと整合したものとなるように設定する。

(3) 更に、このAIガバナンス・ゴールを達成するための「AIマネジメントシステムの設計」を行った上で、これを「運用」する。その際には、各主体が、AIガバナンス・ゴール及びその運用状況について外部の「ステークホルダーに対する透明性、アカウンタビリティ(公平性等)」を果たすようにする。

(4) その上で、リスクアセスメント等をはじめとして、AIマネジメントシステムが有効に機能しているかを継続的にモニタリングし、「評価」及び継続的改善を実施する。

(5) AIシステム・サービスの運用開始後も、規制等の社会的制度の変更等の「外部環境の変化」を踏まえ、再び「環境・リスク分析」を実施し、必要に応じてゴールを見直す。

このようなAIガバナンスは、ガイドラインによれば、サイバー空間とフィジカル空間を高度に融合させたシステム(Cyber-Physical System、CPS)の社会実装を進めるために必要なものとされている。なお、このAIガバナンスの主語は「各主体」であることから、AI開発者、AI提供者、AI利用者それぞれがAIガバナンスを実施することが期待されているようではある。しかし、各主体ともそれぞれの立場に起因する限界があり、適宜連携を取りながら、AIガバナンスを実施していくほかはないように思える。

ガイドラインでは、各主体間で連携しバリューチェーン全体で『共通の指針』を実践しAIを安全安心に活用していくためには、AIに関するリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる便益を最大化するための、AIガバナンスの構築が重要となるとする14。

具体的には、

(1) AIシステム・サービスがライフサイクル全体においてもたらしうる便益/リスク、開発・運用に関する社会的受容、外部環境の変化、AI習熟度等を踏まえ、対象となるAIシステム・サービスに関連する「環境・リスク分析」を実施する。

(2) これを踏まえ、AIシステム・サービスを開発・提供・利用するか否かを判断し、開発・提供・利用する場合には、AIガバナンスに関するポリシーの策定等を通じて「AIガバナンス・ゴールの設定」を検討する。なお、このAIガバナンス・ゴールは、各主体の存在意義、理念・ビジョンといった経営上のゴールと整合したものとなるように設定する。

(3) 更に、このAIガバナンス・ゴールを達成するための「AIマネジメントシステムの設計」を行った上で、これを「運用」する。その際には、各主体が、AIガバナンス・ゴール及びその運用状況について外部の「ステークホルダーに対する透明性、アカウンタビリティ(公平性等)」を果たすようにする。

(4) その上で、リスクアセスメント等をはじめとして、AIマネジメントシステムが有効に機能しているかを継続的にモニタリングし、「評価」及び継続的改善を実施する。

(5) AIシステム・サービスの運用開始後も、規制等の社会的制度の変更等の「外部環境の変化」を踏まえ、再び「環境・リスク分析」を実施し、必要に応じてゴールを見直す。

このようなAIガバナンスは、ガイドラインによれば、サイバー空間とフィジカル空間を高度に融合させたシステム(Cyber-Physical System、CPS)の社会実装を進めるために必要なものとされている。なお、このAIガバナンスの主語は「各主体」であることから、AI開発者、AI提供者、AI利用者それぞれがAIガバナンスを実施することが期待されているようではある。しかし、各主体ともそれぞれの立場に起因する限界があり、適宜連携を取りながら、AIガバナンスを実施していくほかはないように思える。

EU規則でガバナンスとして触れられているのは、EUレベルで設けられる組織と加盟国レベルで設けられる組織についてである。EUレベルでは、AIオフィス(欧州委員会の組織の一部)、欧州人工知能理事会(加盟国の代表で構成される会議体)、アドバイザリー・フォーラム(産業界や消費者団体で構成される会議体)、科学パネル(独立専門家による会議体)が設立される。また加盟国では市場監視当局(具体的にAIシステムを監視する組織)が設置される。

EU規則において、ガイドラインでいうところのAIガバナンスに近しいものは、市販後モニタリングであろう。主な規定だけを抜き出すと、以下の通りである。

すなわち、提供者は、AI技術の性質と高リスクAIシステムのリスクに見合った方法で、市販後モニタリングシステムを確立し、文書化する(72条1項)。市販後モニタリングシステムは、配備者から提供されるか、又は他の情報源を通じて収集される、高リスクAIシステムの性能に関する関連データを、その耐用期間を通じて、積極的かつ体系的に収集、文書化及び分析しなければならない。そしてこれにより、提供者は、AIシステムがIII章2節(高リスクAIシステムの満たすべき要件)に定める要件に継続的に適合していることを評価できるようにしなければならない(72条2項)とする。

ガイドラインでは、AIシステムとして、社会的受容等も含めて、PDCAを回して機能改善を目指していくこととされている。これに対し、EU規則の市販後モニタリングでは、高リスクAIシステムの要件を満たしているかどうかをモニタリングして、適宜修正を行うというものである。ガイドラインの方は改善を目指すという意味付けが強いという相違点はある。しかし、いずれもモニタリング⇒修正の過程で改善を図ることが期待されているものであり、類似の性質を有するものと考える。

14 前掲注1 p24参照

EU規則において、ガイドラインでいうところのAIガバナンスに近しいものは、市販後モニタリングであろう。主な規定だけを抜き出すと、以下の通りである。

すなわち、提供者は、AI技術の性質と高リスクAIシステムのリスクに見合った方法で、市販後モニタリングシステムを確立し、文書化する(72条1項)。市販後モニタリングシステムは、配備者から提供されるか、又は他の情報源を通じて収集される、高リスクAIシステムの性能に関する関連データを、その耐用期間を通じて、積極的かつ体系的に収集、文書化及び分析しなければならない。そしてこれにより、提供者は、AIシステムがIII章2節(高リスクAIシステムの満たすべき要件)に定める要件に継続的に適合していることを評価できるようにしなければならない(72条2項)とする。

ガイドラインでは、AIシステムとして、社会的受容等も含めて、PDCAを回して機能改善を目指していくこととされている。これに対し、EU規則の市販後モニタリングでは、高リスクAIシステムの要件を満たしているかどうかをモニタリングして、適宜修正を行うというものである。ガイドラインの方は改善を目指すという意味付けが強いという相違点はある。しかし、いずれもモニタリング⇒修正の過程で改善を図ることが期待されているものであり、類似の性質を有するものと考える。

14 前掲注1 p24参照

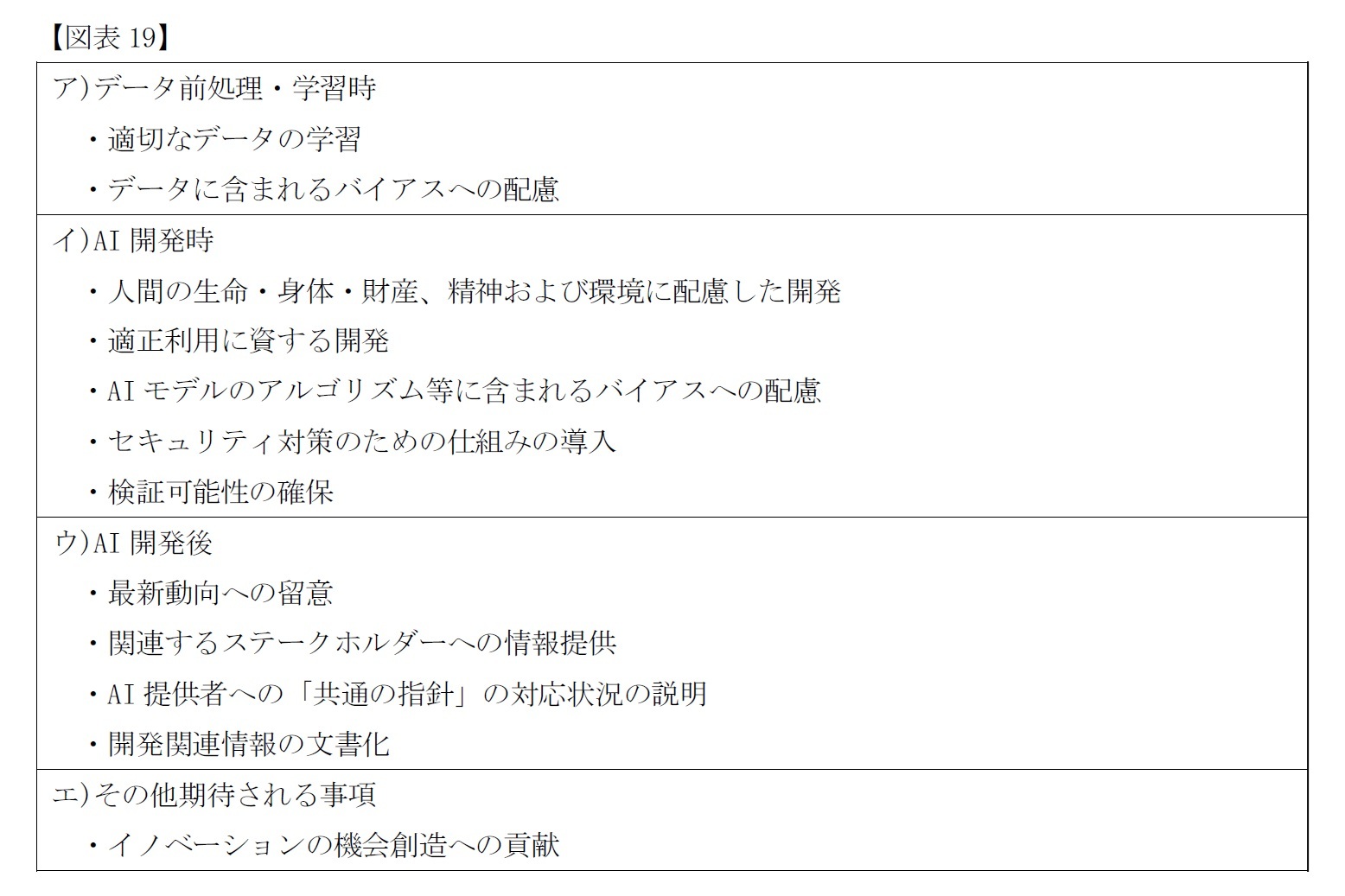

まず、ア)であるが、EU規則における「データによるAIモデルの学習を行う高リスクAIシステムは、学習用のデータセットを使用する場合は、(中略)品質基準を満たす学習、検証、テストのデータセットに基づいて開発されなければならない」(10条1項)に該当する。

つぎに、イ)であるが、これは人の生命や身体あるいは環境などに危害を及ぼさないように設計されるべきということがポイントとなっている。そうすると、EU規則では高リスクAIシステムの満たすべき要件である「リスク管理措置は、各ハザード(危険)に関連する残余リスク、及び高リスクAIシステムの全体的な残余リスクが許容可能であると判断されるものでなければならない」(9条5項)と同様の位置づけを有することと考えられる。

また、ウ)であるが、これはEU規則では使用説明書の作成及びEUデータベースへの登録(13条2項、71条1項、付属書Ⅷの12)義務によって確保される。

エ)については期待される事項であることから、省略する。

このようにガイドラインが定めるAI開発者に関する事項(=求められる事項)はEU規則でも規定されているものと言える。AIシステムが人の権利や安全に悪影響を与えたとしたら、まずAIシステムの機能や動作についてAI開発者に一種の製造物責任が求められることとなることから、各種の義務が課せられることは当然のことと考えられる。

15 前掲注1 p26~p28参照

つぎに、イ)であるが、これは人の生命や身体あるいは環境などに危害を及ぼさないように設計されるべきということがポイントとなっている。そうすると、EU規則では高リスクAIシステムの満たすべき要件である「リスク管理措置は、各ハザード(危険)に関連する残余リスク、及び高リスクAIシステムの全体的な残余リスクが許容可能であると判断されるものでなければならない」(9条5項)と同様の位置づけを有することと考えられる。

また、ウ)であるが、これはEU規則では使用説明書の作成及びEUデータベースへの登録(13条2項、71条1項、付属書Ⅷの12)義務によって確保される。

エ)については期待される事項であることから、省略する。

このようにガイドラインが定めるAI開発者に関する事項(=求められる事項)はEU規則でも規定されているものと言える。AIシステムが人の権利や安全に悪影響を与えたとしたら、まずAIシステムの機能や動作についてAI開発者に一種の製造物責任が求められることとなることから、各種の義務が課せられることは当然のことと考えられる。

15 前掲注1 p26~p28参照

2|AI提供者に関する事項16

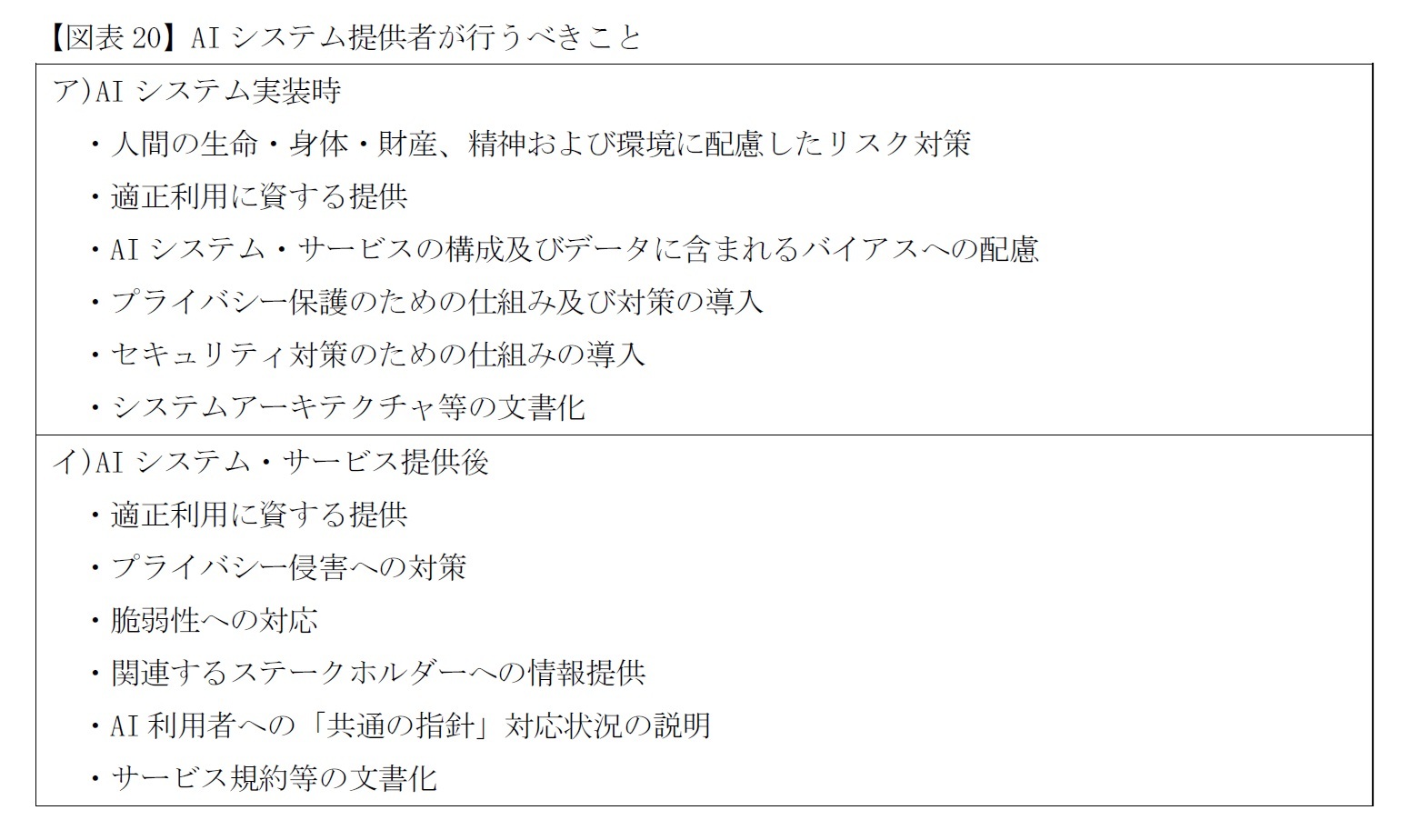

AI 提供者は、AI開発者が開発するAIシステムに付加価値を加えてAIシステム・サービスをAI利用者に提供する役割を担う。AIを社会に普及・発展させるとともに、社会経済の成長にも大きく寄与する一方で、社会に与える影響の大きさゆえに、AI提供者は、AIの適正な利用を前提としたAIシステム・サービスの提供を実現することが重要となる。そのため、AI提供者はAIシステム・サービスに組み込むAIが当該システム・サービスに相応しいものか留意することに加え、ビジネス戦略又は社会環境の変化によってAIに対する期待値が変わることも考慮して、適切な変更管理、構成管理及びサービスの維持を行うことが重要である。具体的には、以下の通り(図表20)である。

AI 提供者は、AI開発者が開発するAIシステムに付加価値を加えてAIシステム・サービスをAI利用者に提供する役割を担う。AIを社会に普及・発展させるとともに、社会経済の成長にも大きく寄与する一方で、社会に与える影響の大きさゆえに、AI提供者は、AIの適正な利用を前提としたAIシステム・サービスの提供を実現することが重要となる。そのため、AI提供者はAIシステム・サービスに組み込むAIが当該システム・サービスに相応しいものか留意することに加え、ビジネス戦略又は社会環境の変化によってAIに対する期待値が変わることも考慮して、適切な変更管理、構成管理及びサービスの維持を行うことが重要である。具体的には、以下の通り(図表20)である。

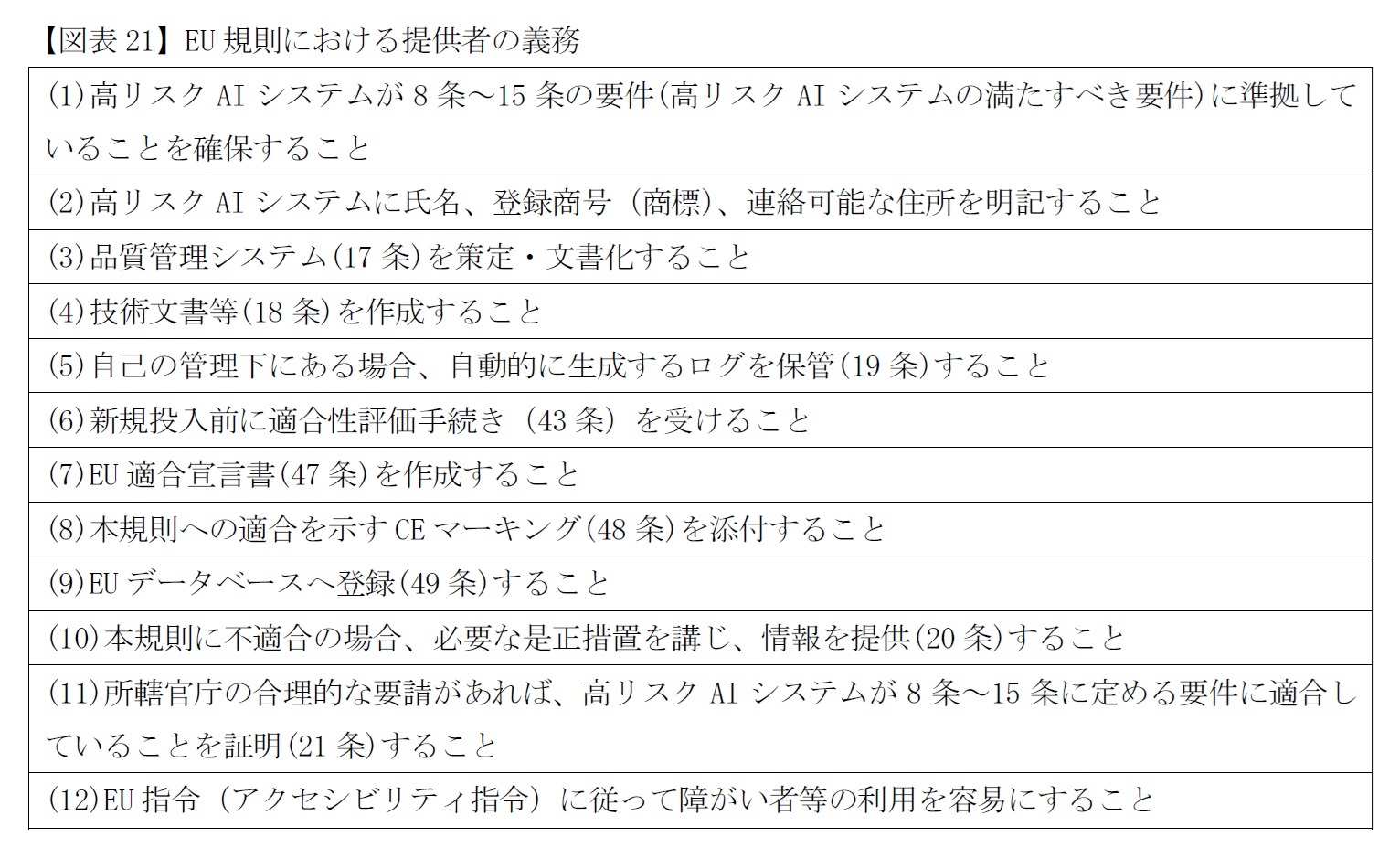

そのほか、所轄官庁からの監督を受けることや、障がい者等の利用を容易にすることなどの相違点もある。

16 前掲注1 p31~p33参照。

16 前掲注1 p31~p33参照。

(2024年12月03日「基礎研レポート」)

03-3512-1866

経歴

- 【職歴】

1985年 日本生命保険相互会社入社

2014年 ニッセイ基礎研究所 内部監査室長兼システム部長

2015年4月 生活研究部部長兼システム部長

2018年4月 取締役保険研究部研究理事

2021年4月 常務取締役保険研究部研究理事

2024年4月 専務取締役保険研究部研究理事

2025年4月 取締役保険研究部研究理事

2025年7月より現職

【加入団体等】

東京大学法学部(学士)、ハーバードロースクール(LLM:修士)

東京大学経済学部非常勤講師(2022年度・2023年度)

大阪経済大学非常勤講師(2018年度~2022年度)

金融審議会専門委員(2004年7月~2008年7月)

日本保険学会理事、生命保険経営学会常務理事 等

【著書】

『はじめて学ぶ少額短期保険』

出版社:保険毎日新聞社

発行年月:2024年02月

『Q&Aで読み解く保険業法』

出版社:保険毎日新聞社

発行年月:2022年07月

『はじめて学ぶ生命保険』

出版社:保険毎日新聞社

発行年月:2021年05月

松澤 登のレポート

| 日付 | タイトル | 執筆者 | 媒体 |

|---|---|---|---|

| 2025/10/28 | 東宝の自己株式取得-公開買付による取得 | 松澤 登 | 研究員の眼 |

| 2025/10/22 | 米連邦地裁、Googleへの是正措置を公表~一般検索サービス市場における独占排除 | 松澤 登 | 基礎研レポート |

| 2025/10/15 | 芝浦電子の公開買付け-ヤゲオのTOB成立 | 松澤 登 | 研究員の眼 |

| 2025/10/09 | ソニーのパーシャル・スピンオフ-ソニーフィナンシャルの分離・上場 | 松澤 登 | 研究員の眼 |

新着記事

-

2025年11月04日

数字の「26」に関わる各種の話題-26という数字で思い浮かべる例は少ないと思われるが- -

2025年11月04日

ユーロ圏消費者物価(25年10月)-2%目標に沿った推移が継続 -

2025年11月04日

米国個人年金販売額は2025年上半期も過去最高記録を更新-但し保有残高純増は別の課題- -

2025年11月04日

パワーカップル世帯の動向(2)家庭と働き方~DINKS・子育て・ポスト子育て、制度と夫婦協働が支える -

2025年11月04日

「ブルー寄付」という選択肢-個人の寄付が果たす、資金流入の突破口

お知らせ

-

2025年07月01日

News Release

-

2025年06月06日

News Release

-

2025年04月02日

News Release

【AI事業者ガイドライン-総務省・経済産業省のガイドライン】【シンクタンク】ニッセイ基礎研究所は、保険・年金・社会保障、経済・金融・不動産、暮らし・高齢社会、経営・ビジネスなどの各専門領域の研究員を抱え、様々な情報提供を行っています。

AI事業者ガイドライン-総務省・経済産業省のガイドラインのレポート Topへ

各種レポート配信をメールでお知らせ。読み逃しを防ぎます!

各種レポート配信をメールでお知らせ。読み逃しを防ぎます!